今回は、AI(Artificial Intelligence:人工知能)品質の課題を解説します。

AIとは

AI(人工知能)とは、計算機により高度な知的処理を実現したものです[1]。今どきのAIは、ほぼ機械学習を用いて実現しています。したがって、現時点においてはAI≒機械学習と考えてよいと思います。機械学習とは、大量のデータの中から規則性や判断基準などを抽出することにより、識別や予測を行う機能を実現する技術です。よく耳にする深層学習も機械学習の一つで 、多層のニューラルネットワークによる機械学習手法です。機械学習による予測精度を上げるには、大量のデータによる学習が欠かせません。

近年AIが注目されるようになった理由

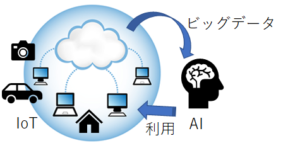

なぜ近年これだけAIが話題になるようになったのでしょうか。それは、クラウドとIoTの進展によってビッグデータが手に入るようになったことが大きく関係します。IoTシステムにつながるカメラやセンサーなどのIoTデバイスから収集される大量のデータ、これがビッグデータです。このビッグデータを学習して、AI予測モデルは作成されるのです。つまり現在は、IoTシステムが増えると、ますますクラウドにデータが集まり、そのデータを学習してAI予測モデルが作られて利用されるという循環が回っているのです。

AI予測モデルの特徴

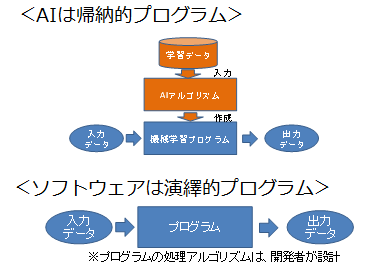

AI予測モデル(図中の機械学習プログラム)は、AIアルゴリズムが学習データを入力して生成します。このAI予測モデルは、人間が作成するのではなく、AIアルゴリズムが作成したものであり、 その処理アルゴリズム は非常に複雑で、人間にとってほぼブラックボックスです。AI予測モデルは、学習データを入力として生成されるため、帰納的プログラムと呼ばれることがあります。これに対して従来のソフトウェアは、人間が処理アルゴリズムを設計していますので、処理アルゴリズムがわからないということはありません。AI予測モデルが帰納的プログラムであるのに対して、従来のソフトウェアは演繹的プログラムと呼ぶことができます。AI予測モデルは、処理アルゴリズムがわからないという点が、従来のソフトウェアと全く異なります。

AI品質の課題

AI予測モデルの処理アルゴリズムがわからないという点が、AI品質に大きく影響します。処理アルゴリズムがわからないということは、テストしても正解がわからないということです。もちろん、予測精度80%というように、確率的に確認することはできますが、個々のケースの正解はわからないのです。AI予測モデルをテストしようとしても、入力値に対する期待値が不明なので、どういう出力値ならOKと言えるのかがわからない。これが、AI品質の最大の課題です。従来のソフトウェアであれば、処理アルゴリズムがわかっていて、テストの期待値もわかるので、テスト完了を宣言できますが、AI予測モデルは、どこまでテストしたらOKと言えるのかがわかっていません。

説明可能性(explanability)の課題

AIを利用する側にとっても課題があります。現在のAIでは、なぜその予測結果となったのかという理由を示すのが難しいのです。AI予測モデルの処理アルゴリズムがわからないので、個々のケースにおいて、その予測結果が導かれる理由(例えば、どの要因が最も影響しているのかなど)を説明できないのです。これは、利用者から見ると、予測結果の納得性に欠けることになり、予測そのものの信ぴょう性に関わります。

倫理面の課題

さらに、最近重要視されているのは、倫理面の課題です。代表的なものに、公平性の問題があります。これは、AI予測モデルが、データを学習して生成されるため、現実のデータが健全でない状態だと、そのとおりに予測してしまうことから起こります。例えば、AIによる銀行の与信審査を考えてみましょう。現時点において、世の中の男女の平均所得は男性のほうが高いという事実があります。このため、その現実のデータで学習したAIが予測すると、女性というだけで(所得が低いとみなして)与信審査が通らなくなってしまうということが起こり得るのです。AI予測では、このような倫理面を考慮することが求められます。しかし、倫理観は人によって異なるので正解がなく、一律にこうすればよいと決められないところが、この問題をさらに難しくしています。

最後に

AI利用は、急激に進展していますが、実際には技術的に解決できていない課題がたくさんあります。だからといって、AI利用を止めるということではありません。AIの課題は、現在進行形で世界中の研究者や技術者が解決に取り組んでいます。AIを提供する側は、AIの課題に真摯に向き合いつつ、歩みを止めないという姿勢が求められるのだと思います。